别再死磕本地部署了。自己搭 OpenClaw 这种工具,要么得反复折腾 Docker 环境,要么得担心给出的高权限会不会导致隐私泄露。飞书刚上线的这个云 OpenClaw 算是把门槛直接踩平了:云端托管、一步创建,最重要的是,目前这波福利给得很直接。

为什么要关注这次“云端化”?

以前玩 OpenClaw,很多人卡在“既要又要”的矛盾里:想要自动化效率,又怕本地 Token 消耗太快,还得维护服务器。这次飞书官方下场搞云端版,核心解决了两个痛点:

- 零门槛部署:跳过了所有环境配置,直接在云端点几下就完事。

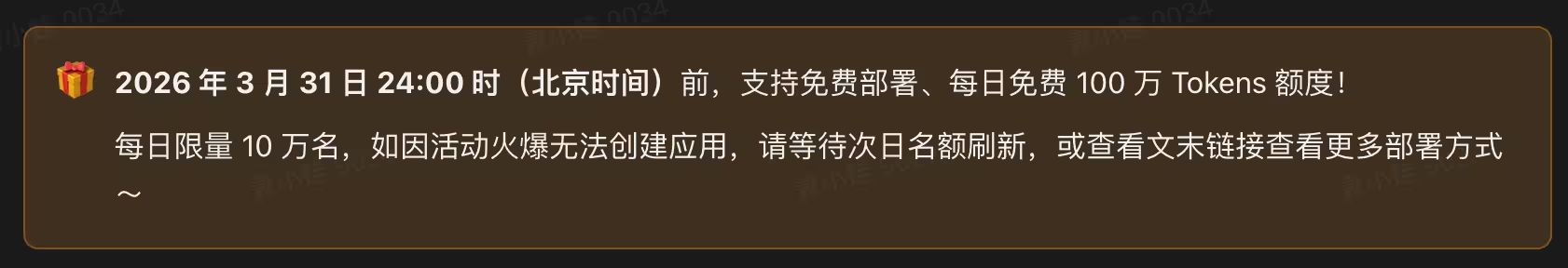

- 暴力白嫖额度:限免期间,每天直接给 100 万 Tokens(注:原文标题写 10 万,正文写 100 万,建议按 100 万刷,额度管够)。

- AI管理AI:非常有趣的是,作为 AI 中的 AI,当出现故障时,飞书可以接管 OpenClaw:

核心配置与实操细节

虽然是云端托管,但它的灵活性没被阉割。你可以根据业务需求,通过简单的参数配置实现定制化。

1. 灵活更换大模型

别以为被锁死在飞书自家的模型上。你可以根据自己的 API Key 随意切换。

- 在配置界面找到 Model ID 字段。

- 填入你想调用的模型名(如 GPT-4o 或 Claude 3.5)。

- (实测建议:如果是处理文档摘要,默认的就够用;如果是写代码,建议切回自己的主力模型)。

2. 权限隔离与隐私

云 OpenClaw 最大的优势是不再需要你把本地服务器的各种 Hook 暴露在公网。飞书在内部链路做了封装,通过云端 API 鉴权代替了传统的明文 Key 传输。

避坑指南与注意点

- 时间窗口:限免只到本月底。这明显是拉新的策略,建议先把环境占上,把每日 100 万的 Tokens 额度跑起来,做自动化流或者大规模文本预处理。

- 并发限制:虽然 Tokens 给得多,但并发频率(QPS)肯定有限制。别指望用它跑高频高并发的爬虫任务。

- 隐私界限:虽然解决了本地泄密风险,但数据毕竟过了云端。极度敏感的核心代码逻辑,还是建议脱敏后再喂。

如何快速跑通?

- 进到飞书开发者后台或应用中心,搜 OpenClaw或者直接点击打开 https://miaoda.feishu.cn/bot。

- 起一个名字,再次点击创建:

- 等待创建完成就好了

(这里有个小坑:如果创建失败,大概率是当天的 10 万个创建名额抢光了,记得凌晨或者一早去蹲)。

这波福利说白了就是飞书在抢开发者心智。不管是拿来做企业内的工作流自动化,还是单纯当个大模型的“免费跳板”,这波羊毛不薅确实可惜了。

在活动介绍中,只提到了免费部署,但没有提及到期后,这个云 OpenClaw 将如何处置,是销毁,还是继续能用,暂时不知道。

*大家觉得,这种云端托管的自动化工具,会不会最终成为大模型落地的标配形态?

评论 0 条

暂无评论,来种下第一颗种子。